摘要:如何查看robots协议?怎么查看robots协议?怎么写robots协议?所以,seo建议各位站长仅当您的网站包含不希望被搜索引擎收录的内容时,才需要使用robots.txt文件,如果您希望搜索引擎收录网站上所有内容,请勿建立robots.txt文件。

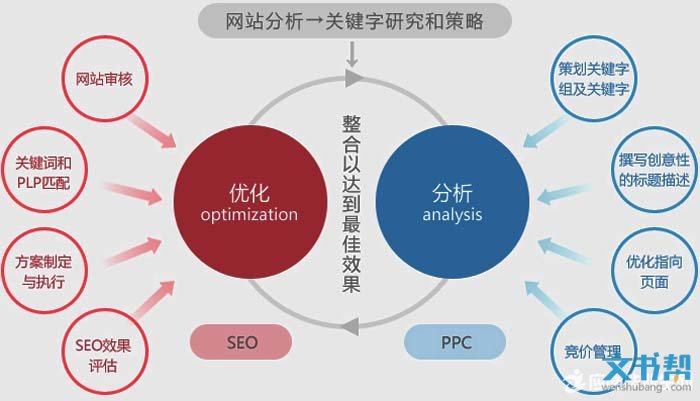

Robots协议即“爬虫排除协议”,它是网站管理员和搜索引擎间的重要沟通工具。借助于此协议,网站管理人员可透过robots.txt文档明确告知搜索引擎哪些网页允许被抓取,哪些则禁止抓取。在搜索引擎优化(SEO)领域中,Robots协议具有举足轻重的地位。接下来,我们将针对Robots协议及其在SEO领域内的重要性展开详尽讨论。

1.Robots协议的基本原理

Robots协议的关键作用在于通过指定robots.txt文件向搜索引擎爬虫传达网站页面的访问权限信息。此文件常置于网站根目录,为搜索引擎访问网站时优先关注的对象。通过使用该协议,网站管理员可精确管理搜索引擎爬虫对网站数据的抓取策略。

2.Robots.txt的作用与使用规范

Robots.txt旨在指导爬虫程序从服务器获取可抓取的文件。对于需限制搜索引擎抓取的网站内容,站长们可通过该文件进行操作。反之,若希望所有页面均被索引,则无需设立此文件。

在实践中,运用robots.txt须恪守相应规范。仅能管理同种协议、端口与站点下的网页获取策略。且在获取过程中,爬虫会明确标识自身身份,如"User-agent",因此,利用此项特性便可轻松区分各大搜索引擎的爬虫应用。例如,Google网页索引机器人的"User-agent"设定为"Googlebot",据此,网站管理员可根据需求,通过robots.txt对各类爬虫程序进行个性化的抓取策略配置。

3.Robots协议对SEO的重要性

Robots协议对于SEO起着举足轻重的作用。透过精心设置的robots.txt文件,站长可调节搜索引擎抓取内容的权限,进而影响网站在搜寻结果中的名次。科学运用Robots协议能进一步提高网站的易用性及SEO功效,为网站吸引更多关注并增加访客量。

4.Robots协议与搜索引擎的互动

尽管机器人协议可对搜索引擎的抓取权限进行明确规定,然而即便部分页面受到禁抓限制,搜索引擎仍有可能透过其他途径将之纳入其索引体系。因此,网站运营者在运用robots.txt文件之外,也应借助其他技术策略以实现更完善的站点内容管控及优化效果。

5.其他元标记的应用

除机器人协议文件(robots.txt)外,其他元标记在搜索引擎优化(SEO)过程中的地位同样举足轻重。其中,'noindex'元标记可完全屏蔽特定网页内容进入索引,实现搜索引擎的封锁;而'nofollow'元标记则主要防止爬虫追踪页面内链接,进而影响权重传递。

6.Crawl-delay的意义

此外,Robots协议中的重要参数Crawl-delay被广泛采用,该参数设定了爬虫访问网站的时间间隔,以实现对网站访问频率的控制与管理,从而降低网站服务器压力并合理分配资源,确保网站的高效运行。

7.Robots协议的发展与未来趋势

在网络科技飞速发展及搜索引擎技术持续提升的背景下,机器人协议亦日益精进。展望将来,依托人工智能和大数据技术的强大支持,机器人协议有望实现更精确的个性化定制,以更好满足各类网站及搜索引擎算法的快速演进。

8.结语

总之,Robots协议作为站长与搜索引擎关系中的关键环节禁止百度收录robots代码禁止百度收录robots代码,在SEO过程中发挥无可或缺的作用。运用得当的Robots协议能有效规范搜索引擎的收录行为,提高站点的可用度及搜索引擎排名效果。展望未来,随着科技水平日益提高,Robots协议亦将持续发展并适应网络环境及搜索引擎算法的变更。

在网站管理与优化过程中,阁下是采用哪种策略来通过使用robots协议提升网站SEO性能的呢?对于Robot协议的未来趋势以及创新建议,阁下是否有所期许或见解?敬请留言分享贵方独到的看法及宝贵的实践经验。