摘要:一般情况下,大多数网站创建者或管理员都会在网站的根目录放置一个名为robots.txt的文本文件,用来控制自己的网站哪些目录允许SE搜索引擎爬行并收录,哪些目录禁止搜索引擎收录,Disallow,正是robots.txt文件中设置禁止搜索引擎收录哪些目录的一个词语。

在网络管理领域里,Robots.txt扮演决定搜索引擎行为和设定访问规则的关键角色。本文深入探讨了它的基础功能及其格式,包括收录权限与限制、针对特定搜索引擎的收录规定以及文件规范等多方面内容,旨在协助网站管理员有效利用Robots.txt,确保网站安全和隐私不受侵害。

robots.txt的基本概念

Robots.txt是放置于网站根目录下的纯文字TXT文档禁止百度收录robots代码,主要用于规定搜索引擎机器人可以爬行或禁止爬行的网页,以此优化搜索策略。首次光顾网站的爬虫会优先检索此文档,其内容对爬行指令有着重大影响。站长可以巧妙运用Robots.txt文件,精确控制搜索引擎对网站信息的访问与收录,确保网站安全与隐私得到保护。

robots.txt的作用

robots.txt的作用主要体现在以下几个方面:

配置爬虫权限:通过使用robots.txt文件禁止百度收录robots代码,网站管理者及可以精确地指定哪些页面授权给搜索引擎进行检索与收录,同时确保特定内容免遭索引,从而有效防止搜索引擎机器人获得网站敏感信息,保证网站数据安全可靠。

合理规划和设置robots.txt对于提高网站SEO效果具有明显作用。我们应当优先选择重要网页并赋予其更高的索引权值,以便搜索引擎准确检索并收集网站的主要信息,进一步提升网站于搜索结果内的排名表现。

提升站点性能:适度调整搜索引擎的抓取率,可有效缓解服务器压力并提高网页载入与运行速度。

借由robots.txt文件,运营者得以妥善调整搜索引擎的数据更新节奏,防备各类威胁如恶意探测和信息泄漏等情况。

针对网站运营,robots.txt起到至关重要的角色。经过恰当且精确地运用,可提高网站安全程度与搜索引擎排名效益,进而提升整体运营成效。

robots.txt文件格式

以下为robots.txt文档必需体现的核心内容列举:

User-Agent标识能清晰揭示搜索引擎的具体分析形式以及其特定名称。如,“*”符号便表示涵盖所有搜索引擎,而“Baiduspider”明确表明此工具乃为百度搜索引擎所专属。

精细化访问管控:借助该功能,可以对特定页面或目录的内容进行精准的访问限制。譬如,在终端环境输入"Disallow:/private/"指令,便能防止搜索引擎爬取并索引网站根目录下的私密文件。

借助精确配置的Allow与Disallow参数,我们得以对搜索引擎的行为进行严谨而细致的限制,确保其仅能检索特定页面及布局。

「爬行延迟」特性:通过调整搜索引擎的网页抓取周期(以秒为单位)来实施访问控制,从而避免频发访问导致的服务器负载过重问题。

即便Robots.txt规范明确,然而在实践运用中,遵守语法与逻辑严谨性的重要性不容忽视,以期实现最佳效果。

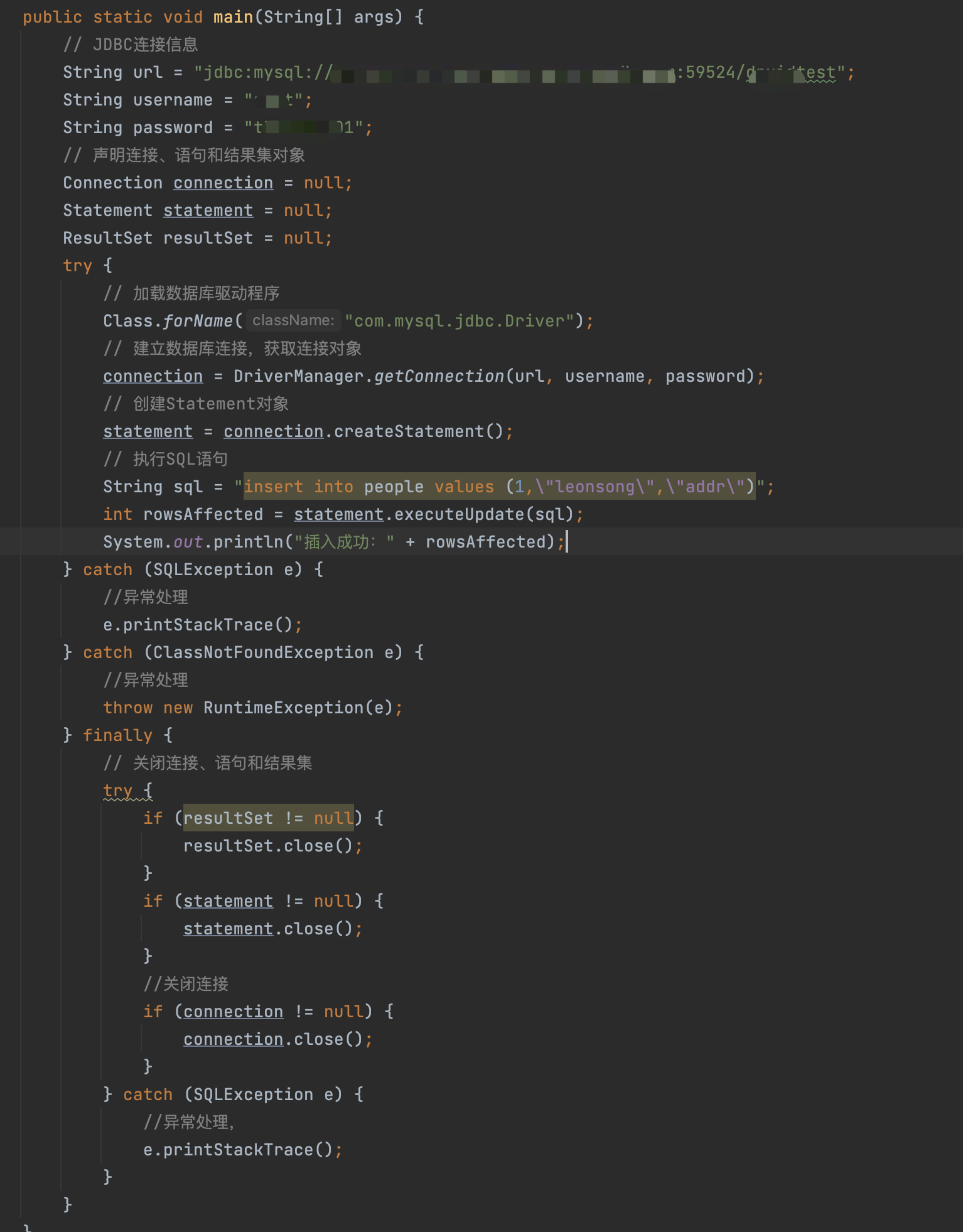

robots.txt文件示例

本文献备有翔实示例,详解编写robots.txt以引导检索引擎最佳爬行策略。

```

User-agent:*

Disallow:/private/

Disallow:/admin/

Allow:/public/

Crawl-delay:10

在本例中,"*"用作通配符,代表对全部搜索引擎的指令处理;运用disallow指令,可避免私人与管理员子目录受检索干扰;而通过enableallow命令,则赋予公众目录的访问权限。此外,通过设定crawl-delay参数值,将每次检索的时间间隔固定为10秒。

结语

在网络维护过程中,站长通过对Robots.txt文件的巧妙运用,实现了网站安全的保障以及搜索引擎优化(SEO)效能的提升,从而显著提高了其工作效率。精准设定Robots.txt可使站长适当把握搜索引擎的访问规则,以优化网站质量及用户体验。因此,深入理解与恰当地运用Robots.txt显得至关重要。

运用ROBOTS指令文件在网站监测领域的重要价值,阐述您对此种工具的独特观点及实际应用所面临的挑战与难题。恳切期望听到您独特视角与丰富实践经验,以分享并借鉴您的丰硕研究成果。