摘要:如何让我的网站(独立网站或者blog)被百度收录?如何查看我的网站是否被百度收录?百度会收录符合用户搜索体验的网站和网页。如何让我的网页不被百度收录?

在数字化浪潮中,创建自己的网页和博客已逐渐成为展示自我功力与实力的有力手段。然而,如未能被搜索引擎录入其中,再好的网页也无法发挥出真正效益。作为我国搜索引擎领域的翘楚,百度在网页收录方面起着决定性作用。因此,站长们对于如何将网页纳入百度检索体系以提高曝光率,以及如何检查网页是否已被收录充满了关注。

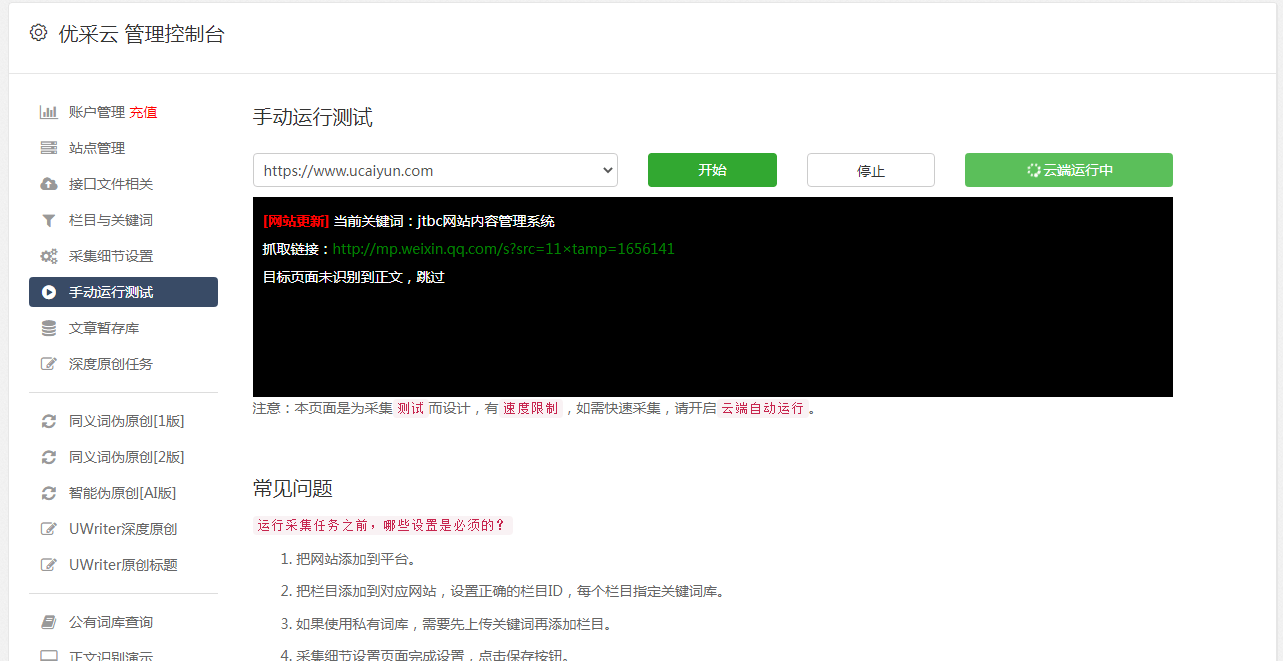

要让百度快速找到您的站点,最佳策略就是提交主页链接。运用百度站长工具平台,操作简单易行,只需填入相应信息即可。但请注意,只需要提供主页链接,不必包括其他上下文页面。百度的爬虫会根据您提供的链接进入并收录相应内容。

网页收录机制

百度通过评估网页质量和用户搜索体验,确保公正中立,不受到任何商业影响或竞价排名竞争所左右。即便无需付费推广,只要保证网站具备丰富优质的内容并满足用户需求,便有机会被收录。因此,站长必须重视网站内容品质及用户体验,提升被搜索引擎收录的几率。

使用site语法查看收录情况

要核实贵网站是否被百度收录,最佳方法是借用百度搜索引擎的“site”关键字进行查询。例如,在百度搜索栏里输入“site:你的域名”(例如"site:example.com"),若有相关结果出现,便可推断贵网站已被百度收录。但需留意,此方法所获结果仅是粗略估算,仅供参考,并不确保百度已全面收录贵网站所有页面信息。

如何让网页不被百度收录

多数站长致力于将网站推向搜索引擎百度不收录二级域名,但部分站点出于个人隐私及保密内容考虑,会选择限制百度对其网页的收录。因此,我们可以通过更改Robot文件来实施这种操作,以此引导百度蜘蛛的爬行和索引方式。常用的策略是,在站点根目录中创建一份名为"robots.txt"的文件,其中列明禁止百度机器人索引的特定页面或目录。

Robots文件设置方法

在进行Robots文件的编写过程中,必须严格按照Robots协议规范,根据具体需求设置相应指令。如欲全面禁止百度抓取本站内容百度不收录二级域名,只需在Robots文件配置以下语句即可实现。

```

User-agent:Baiduspider

Disallow:/

本文档旨在提醒百度爬虫,无需访问指定站点的任何页面。若需限制特定目录内的页面,请填写对应用户目录路径至Disallow项。请留意,Robots文件更新并非立即生效,仍需等待短暂延迟。同时,先前收录的相关内容在一段时期内依然会显示在搜索结果中。

紧急情况处理

若需尽快解决百度误收录问题,请发送邮件至webmaster@baidu.com,详述您的观点及相关链接进行核实。若需处理时间可能较长,百度会根据具体情况予以回复,请耐心等待。

凭借上述策略,用户将清晰领悟网站如何被收录至百度索引以及检查其入站效果之道;了解如何设置robots文件以及在遇到紧急问题时应如何处理,以提升网站的可见性及搜索排名。从而,更精准地掌握网站在搜索引擎中的运行轨迹。

实践操作中,除以上手段外,改善网站内容质量、提升用户体验以及扩大外部链接范围均可以有效提高搜索引擎的收录率。与此同时,需高度重视并及时监控网站的收录情况,适时调整优化策略对于保障网站的持续展示效果具有关键作用。

结语

在网络大环境中,高曝光率对于网站生存和壮大具有重要作用,尤其是在竞争白炽化的市场环境中。其中,百度等搜索引擎的收录情况具有至关重要的影响力。为此,我们特此分享相关策略,帮助提高网站曝光率,吸引广大用户的关注。

身为站长,您是否曾面临过网站搜索引擎收录的问题?对此,您是如何以巧妙的策略应对的?期待您在此留下您的宝贵经验和独特观点。